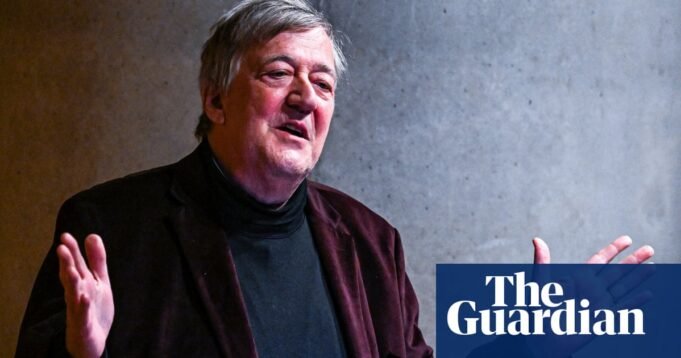

Sistem kecerdasan buatan yang mampu melakukan perasaan atau kesadaran diri berisiko dirugikan jika teknologi berkembang secara tidak bertanggung jawab, menurut surat terbuka yang ditandatangani oleh para profesional dan pemikir AI, termasuk SIR. Stephen Fry.

Lebih dari 100 ahli telah menyajikan lima prinsip untuk melakukan penelitian yang bertanggung jawab tentang AI, seperti Kemajuan cepat menimbulkan kekhawatiran bahwa sistem seperti itu dapat dianggap sensitif.

Prinsip -prinsip tersebut meliputi memprioritaskan penelitian tentang pemahaman dan evaluasi kesadaran dalam AIS, secara berurutan Untuk menghindari “penyalahgunaan dan penderitaan”.

Prinsip -prinsip lainnya adalah: menetapkan batasan pada pengembangan sistem sadar; mengadopsi pendekatan bertahap untuk mengembangkan sistem tersebut; Berbagi temuan dengan publik; dan menahan diri dari membuat pernyataan menipu atau berlebihan tentang penciptaan sadar.

Penandatangan surat itu termasuk akademisi seperti Sir Anthony Finkelstein di University of London dan AI profesional di perusahaan seperti Amazon dan WPP Advertising Group.

Telah diterbitkan bersama dengan a pekerjaan penelitian Yang menggambarkan prinsip -prinsipnya. Artikel itu berpendapat bahwa sistem sadar dapat dibangun dalam waktu dekat, atau setidaknya mereka yang memberi kesan sadar.

“Mungkin saja bahwa sejumlah besar sistem sadar dapat diciptakan dan diderita,” kata para peneliti, dan menambahkan bahwa jika sistem AI yang kuat dapat mereproduksi diri, itu dapat mengarah pada penciptaan “sejumlah besar makhluk baru yang layak mendapatkan pertimbangan moral. “

Dokumen tersebut, yang ditulis oleh Patrick Butlin dari University of Oxford dan Theodoros Lappas dari University of Economics dan Business of Athena, menambahkan bahwa bahkan perusahaan yang tidak bermaksud untuk menciptakan sistem sadar akan membutuhkan pedoman jika “menciptakan entitas sadar secara tidak sengaja”.

Dia mengakui bahwa ada ketidakpastian umum dan ketidaksepakatan tentang definisi kesadaran dalam sistem AI dan jika memungkinkan, tetapi mengatakan itu adalah masalah yang “tidak boleh kita abaikan.”

Pertanyaan lain yang diajukan oleh dokumen fokus pada apa yang harus dilakukan dengan sistem AI jika didefinisikan sebagai “pasien moral”, suatu entitas yang penting secara moral “dalam haknya sendiri, dengan sendirinya.” Dalam skenario itu, ia mempertanyakan apakah akan menghancurkan AI akan sebanding untuk membunuh seekor binatang.

Artikel tersebut, yang diterbitkan dalam Journal of Artificial Intelligence Research, juga memperingatkan bahwa keyakinan yang salah bahwa sistem AI sudah sadar dapat menyebabkan pemborosan energi politik karena upaya yang salah dilakukan untuk mempromosikan kesejahteraan mereka.

Dokumen dan surat itu diselenggarakan oleh Conscium, sebuah organisasi riset yang dibiayai oleh WPP dan ditangkap oleh Direktur IA WPP, Daniel Hulme.

Tahun lalu ke Kelompok akademisi yang lebih tinggi Dia berpendapat bahwa ada “kemungkinan realistis” bahwa beberapa sistem AI sadar dan “signifikan secara moral” pada tahun 2035.

Pada tahun 2023, Sir Demis Hassabis, kepala program AI Google dan pemenang Hadiah Nobel, mengatakan bahwa sistem AI “jelas” saat ini tidak peka, tetapi mereka bisa berada di masa depan.

“Para filsuf belum memutuskan definisi kesadaran, tetapi jika kita merujuk pada kesadaran diri, hal semacam ini, saya pikir ada kemungkinan bahwa AI bisa menjadi suatu hari,” katanya dalam sebuah wawancara dengan stasiun AS tersebut CBS.